페이지를 불러오는 중입니다. 잠시만 기다려주세요...

현대 인공지능 연산은 대규모 데이터 처리, 행렬 기반 연산, 병렬 계산 구조를 필요로 합니다. 이러한 환경에서 텐서 형태의 데이터 구조가 핵심 수학 기반으로 확립되었고, 이를 효율적으로 계산하기 위한 전용 하드웨어가 개발되었습니다. TPU 란 텐서 연산 최적화를 위해 설계된 가속 장치이며, 인공신경망 학습과 추론에서 처리 효율을 높이는 목적을 가집니다. 본 글에서는 텐서 개념과 TPU 구조, 활용 영역 및 기술적 의미를 정리합니다.

TPU와 텐서의 기초 이해

TPU 란 무엇인가

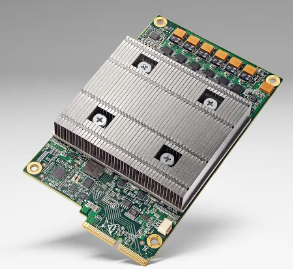

TPU(Tensor Processing Unit)는 구글이 개발한 AI 연산 전용 칩입니다.

기본 목적은 딥러닝 모델의 행렬·벡터 계산 최적화입니다.

기존 CPU, GPU 대비 인공신경망 계산 구조에 특화된 연산 배열을 설계하여, 학습 속도와 전력 효율 개선이 목표입니다.

핵심 특징

- 대규모 행렬 곱셈 처리 유리

- 메모리 접근 경로 단순화

- 딥러닝 프레임워크 TensorFlow 최적 설계

텐서 뜻과 연산 방식

텐서는 다차원 수학 데이터 구조입니다.

스칼라(숫자), 벡터(1차원), 행렬(2차원)을 확장한 형태이며, 딥러닝의 입력·가중치·출력 모두 텐서 형태로 표현됩니다.

간단 예시

- 숫자: 5 → 스칼라

- [1,2,3] → 벡터

- [[1,2],[3,4]] → 행렬

- 이런 구조가 더 높은 차원으로 확장된 형태가 텐서입니다.

딥러닝에서 텐서가 중요한 이유

- 뉴럴네트워크는 행렬 곱셈 반복 구조

- 신호 전달, 가중치 업데이트, 활성화 과정이 텐서 연산

TPU가 주목받는 이유

1) AI 모델 학습 속도

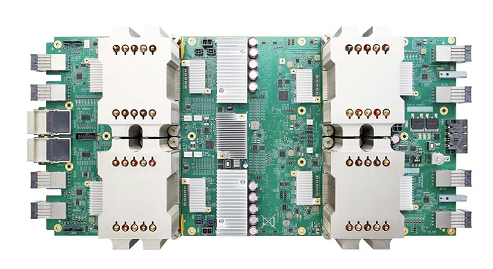

TPU는 행렬 곱셈을 대규모 병렬 방식으로 수행하도록 설계되었습니다.

이 구조 덕분에

- 학습 시간 단축

- 파라미터 수 많은 모델에 최적화

효율적 처리 환경이 형성됩니다.

2) 전력 효율 및 비용 효율

같은 연산량에서 전력 소모가 낮은 편입니다.

실행 비용 최적화를 위한 클라우드 기반 TPU 서비스가 제공되며, 대규모 모델 운영 시 경제성이 강화됩니다.

요약 포인트

- GPU 대비 특정 연산에서 전력-효율 우위

- 클러스터 기반 확장성 용이

3) 대규모 언어 모델 및 자율 시스템 활용

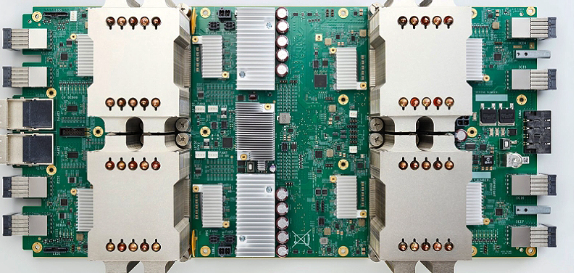

TPU는 언어 모델, 추천 시스템, 음성 인식, 이미지 생성 등 대규모 모델 처리에 활용됩니다.

Google Search, Google Photos, YouTube 추천 등에서 동작하는 AI 시스템 근간에 사용됩니다.

적용 사례

- 자연어 처리 기반 모델

- 컴퓨터 비전 모델

- 대화형 AI 및 생성형 모델

마치면서

TPU 란 딥러닝 구조의 핵심인 텐서 연산을 가속하기 위해 설계된 전용 하드웨어입니다. 텐서 개념은 신경망의 모든 신호와 가중치 구조를 표현하는 수학적 기반이고, TPU는 이를 빠르게 계산하기 위한 병렬 처리 시스템입니다. 계산 효율, 전력 최적화, 대규모 AI 모델 지원 능력이 주목받는 이유이며, 앞으로 고도화된 생성형 AI 인프라에서 중요성이 더욱 확대될 가능성이 큽니다.

TPU는 CPU, GPU와 무엇이 다른가요?

TPU가 GPU보다 항상 빠른가요?

함께하면 좋은 글

최근댓글